Al tempo di Guglielmo Marconi, si pensava che la comunicazione fra un sistema di trasmissione ed uno di ricezione, fosse dovuta esclusivamente ad un flusso di onde elettromagnetiche nello spazio e nel tempo, soggette a dei disturbi su un canale di trasmissione. E’ più facile pensare ad un segnale trasmesso e ricevuto, che attribuirgli un valore informativo. Nel 1948 Claude Elwood Shannon, ingegnere elettrico e matematico statunitense che lavorava come ricercatore presso i laboratori della AT&T Bell telephones in New Jersey, pubblicò un articolo dal titolo: “Mathematical Theory of Communication” edito dalla “Bell systems Technical Journal”.

In Tale articolo trovò che è possibile valutare e misurare l’informazione prodotta da un messaggio trasmesso in un generico sistema di comunicazione continuo e discreto (es: radio,telefono, televisione in bianco e nero, telegrafo), e che la velocità di ogni messaggio è misurabile in RATE (numero bit/secondo). Grazie a questa teoria, nella pratica reale si ha avuto un forte impatto in varie scienze come: la psicologia, la linguistica, economia e biologia . Un aneddoto molto simpatico su Shannon riguarda il suo strano modo di approcciarsi alla formulazione di teorie nuove: secondo la cronaca storica, egli riusciva a trovare nuove idee, solo dopo aver pedalato il suo monociclo lungo i corridoi dei Bell Labs , spaventando i colleghi. Si prodigava a fare delle modifiche al suo monociclo aggiungendo gadget (doppio sedile, motore).

Era tanto appassionato al gioco degli scacchi, al punto che creò un computer che giocava a scacchi autonomamente , ed un topo meccanico che all’interno di un labirinto inseguiva una moneta di ottone (“formaggio”). Egli fu il fondatore della teoria dell’informazione, da cui il nome del settore dell’ ingegneria dell’informazione, e ha dato una forte spinta al settore dell’intelligenza artificiale.

Le estati sempre più torride portano con sé una serie di sfide per le batterie delle auto elettriche, causando potenziali malfunzionamenti, riduzioni della durata e persino danni permanenti. Questi problemi non solo peggiorano le prestazioni del veicolo, ma ne compromettono anche l'affidabilità generale. Proprio come il freddo, anche il caldo estremo rappresenta una minaccia significativa per le batterie al litio, cuore pulsante delle auto elettriche moderne. Le alte temperature possono influenzare negativamente qualsiasi dispositivo tecnologico, comprese le auto elettriche, esponendole a rischi di surriscaldamento quando vengono lasciate al sole per lunghi periodi. Questa situazione è particolarmente critica in un contesto in cui la diffusione delle vetture elettriche rappresenta una delle principali sfide e opportunità per la mobilità sostenibile. Tuttavia, il […]

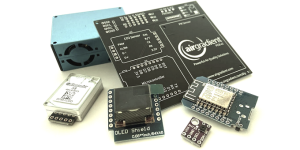

Le estati sempre più torride portano con sé una serie di sfide per le batterie delle auto elettriche, causando potenziali malfunzionamenti, riduzioni della durata e persino danni permanenti. Questi problemi non solo peggiorano le prestazioni del veicolo, ma ne compromettono anche l'affidabilità generale. Proprio come il freddo, anche il caldo estremo rappresenta una minaccia significativa per le batterie al litio, cuore pulsante delle auto elettriche moderne. Le alte temperature possono influenzare negativamente qualsiasi dispositivo tecnologico, comprese le auto elettriche, esponendole a rischi di surriscaldamento quando vengono lasciate al sole per lunghi periodi. Questa situazione è particolarmente critica in un contesto in cui la diffusione delle vetture elettriche rappresenta una delle principali sfide e opportunità per la mobilità sostenibile. Tuttavia, il […] AirGradient è un'azienda che progetta e produce dispositivi per il monitoraggio della qualità dell'aria professionali, accurati e di lunga durata, open source e open hardware. Questi monitor possono essere utilizzati per il monitoraggio della qualità dell'aria sia domestica che esterna. I monitor della qualità dell'aria di AirGradient sono progettati per essere economici e personalizzabili e sono dotati di un codice completamente open source in modo che gli utenti possano apportare facilmente modifiche. La natura open hardware permette anche di costruire in completa autonomia il proprio dispositivo personalizzato. In questo articolo andremo a descrivere come realizzare una versione base di questo dispositivo. Introduzione I dispositivi di monitoraggio di AirGradient sono dotati di sensori che misurano diversi parametri della qualità dell'aria come […]

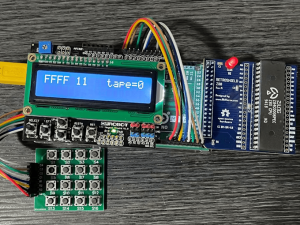

AirGradient è un'azienda che progetta e produce dispositivi per il monitoraggio della qualità dell'aria professionali, accurati e di lunga durata, open source e open hardware. Questi monitor possono essere utilizzati per il monitoraggio della qualità dell'aria sia domestica che esterna. I monitor della qualità dell'aria di AirGradient sono progettati per essere economici e personalizzabili e sono dotati di un codice completamente open source in modo che gli utenti possano apportare facilmente modifiche. La natura open hardware permette anche di costruire in completa autonomia il proprio dispositivo personalizzato. In questo articolo andremo a descrivere come realizzare una versione base di questo dispositivo. Introduzione I dispositivi di monitoraggio di AirGradient sono dotati di sensori che misurano diversi parametri della qualità dell'aria come […] Affascinato dall'idea di costruire un computer fai-da-te UT-88 degli anni '80 a 8 bit, Evgeny Adamenkov ha scelto di seguire un approccio più moderno, realizzando il suo remake con un Arduino Mega 2560, un RetroShield Z80, un display LCD 16x2 e una tastiera 4x4. Incuriosito dall'idea di costruire un computer fai-da-te UT-88 degli anni '80 a 8 bit, Evgeny Adamenkov ha optato per un approccio più moderno, realizzando il suo remake con un Arduino Mega 2560, un RetroShield Z80, un display LCD 16x2 e una tastiera 4x4. Questo progetto non solo preserva l'essenza del computer originale, ma introduce anche una maggiore facilità d'uso grazie alla programmabilità dell'Arduino. Evgeny ha eliminato la necessità di saldature complesse e componenti vintage, rendendo il […]

Affascinato dall'idea di costruire un computer fai-da-te UT-88 degli anni '80 a 8 bit, Evgeny Adamenkov ha scelto di seguire un approccio più moderno, realizzando il suo remake con un Arduino Mega 2560, un RetroShield Z80, un display LCD 16x2 e una tastiera 4x4. Incuriosito dall'idea di costruire un computer fai-da-te UT-88 degli anni '80 a 8 bit, Evgeny Adamenkov ha optato per un approccio più moderno, realizzando il suo remake con un Arduino Mega 2560, un RetroShield Z80, un display LCD 16x2 e una tastiera 4x4. Questo progetto non solo preserva l'essenza del computer originale, ma introduce anche una maggiore facilità d'uso grazie alla programmabilità dell'Arduino. Evgeny ha eliminato la necessità di saldature complesse e componenti vintage, rendendo il […] La robotica educativa rappresenta una delle più avvincenti e potenti modalità di apprendimento contemporaneo, in grado di integrare efficacemente i principi di STEM (Scienza, Tecnologia, Ingegneria e Matematica) nelle aule di tutto il mondo. In un'era dove le competenze digitali sono diventate imprescindibili, l'adozione di programmi di robotica educativa non solo arricchisce il bagaglio conoscitivo degli studenti, ma stimola anche la creatività, la capacità di problem solving e il lavoro di squadra. In questo articolo, esploriamo come la robotica educativa sta rivoluzionando l'insegnamento delle discipline STEM e delineando le sue potenzialità per il futuro dell'educazione. La robotica educativa coinvolge gli studenti in attività pratiche e interattive, permettendo loro di costruire, programmare e manipolare robot. Questo approccio hands-on favorisce un apprendimento […]

La robotica educativa rappresenta una delle più avvincenti e potenti modalità di apprendimento contemporaneo, in grado di integrare efficacemente i principi di STEM (Scienza, Tecnologia, Ingegneria e Matematica) nelle aule di tutto il mondo. In un'era dove le competenze digitali sono diventate imprescindibili, l'adozione di programmi di robotica educativa non solo arricchisce il bagaglio conoscitivo degli studenti, ma stimola anche la creatività, la capacità di problem solving e il lavoro di squadra. In questo articolo, esploriamo come la robotica educativa sta rivoluzionando l'insegnamento delle discipline STEM e delineando le sue potenzialità per il futuro dell'educazione. La robotica educativa coinvolge gli studenti in attività pratiche e interattive, permettendo loro di costruire, programmare e manipolare robot. Questo approccio hands-on favorisce un apprendimento […] Conosciamo tutti il giroscopio e la sua utilità negli smartphone? Si tratta di piccoli dispositivi che sono il vero futuro della tecnologia mobile. Questa breve guida ha lo scopo di offrire una panoramica dettagliata sull'importanza dei giroscopi negli smartphone, evidenziandone le funzionalità e gli utilizzi pratici. L'argomento è di grande interesse per gli appassionati di tecnologia e per coloro che desiderano comprendere meglio come le tecnologie avanzate migliorano la nostra vita quotidiana. I giroscopi sono strumenti tecnologici avanzati utilizzati per misurare e mantenere l'orientamento di un oggetto nello spazio. Basati sul principio della conservazione del momento angolare, i giroscopi rilevano i cambiamenti di orientamento rispetto a un asse fisso. Questi dispositivi sono costituiti da un rotore in rapida rotazione, il […]

Conosciamo tutti il giroscopio e la sua utilità negli smartphone? Si tratta di piccoli dispositivi che sono il vero futuro della tecnologia mobile. Questa breve guida ha lo scopo di offrire una panoramica dettagliata sull'importanza dei giroscopi negli smartphone, evidenziandone le funzionalità e gli utilizzi pratici. L'argomento è di grande interesse per gli appassionati di tecnologia e per coloro che desiderano comprendere meglio come le tecnologie avanzate migliorano la nostra vita quotidiana. I giroscopi sono strumenti tecnologici avanzati utilizzati per misurare e mantenere l'orientamento di un oggetto nello spazio. Basati sul principio della conservazione del momento angolare, i giroscopi rilevano i cambiamenti di orientamento rispetto a un asse fisso. Questi dispositivi sono costituiti da un rotore in rapida rotazione, il […]